Pese a que nos gusta considerarnos criaturas sofisticadas y espirituales, la realidad es bastante más pedestre: los seres humanos compartimos con el resto del reino animal un instinto primario e inevitable por buscar estatus. No podemos evitarlo, aunque el modo en que cada uno busque su sitio sea diferente.

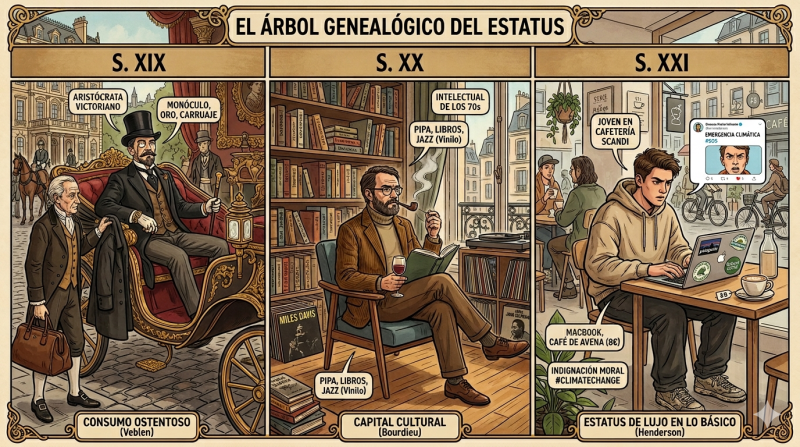

Y de esas diferencias vamos a hablar. El modo en que nos posicionamos frente a los demás ha sufrido una mutación en el último siglo y medio. Hemos pasado del burdo «tener más bienes materiales» a una sofisticación casi invisible. Bienvenidos al árbol genealógico del estatus inmaterial: un viaje para entender algunos aspectos del mundo que realmente es, no del que podría ser o nos gustaría que fuera.

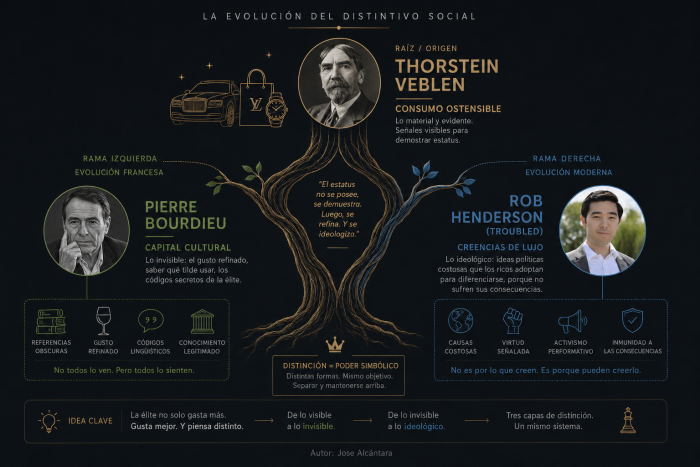

El arbol genealógico del estatus inmaterial

Thorstein Veblen, el consumo conspicuo (Siglo XIX)

Veblen fue un sociólogo estadounidense que a finales del s. XIX escribió su Teoría de la clase ociosa. En el define a la clase ociosa («leisure class») de la revolución industrial, que significa su poderío económico sobre la cantidad de bienes útiles que puede comprar y mostrar, independientemente de que sean útiles o no. En Veblen el estatus se demuestra mediante el derroche.

Así, introduce dos conceptos clave de su ideario:

- Consumo Conspicuo: gastar dinero en cosas visibles y caras pero no necesariamente útiles. Joyas, mansiones, o un mayordomo. ¿Necesitas un mayordomo que te haga el café o abra la puerta a las visitas? No, pero que tus vecinos vean al mayordomo es una señal de estatus.

- Ocio Conspicuo: demostrar que no necesitas trabajar. Estudiar latín, aprender complejísimos protocolos de etiqueta, o jugar al golf.

Todas estas señales de estatus requieren un cierto sacrificio (de dinero, o de tiempo) que los menos privilegiados no pueden permitirse, lo cual sirve para señalizar la pertenencia o no ese grupo que se posiciona mediante las mismas.

Pierre Bourdieu: el capital cultural (Siglo XX)

Cruzamos el Atlántico de vuelta a Europa para rescatar a Pierre Bourdieu. A cuenta de un par de conversaciones dominicales con Antonio Ortiz (y su reciente e hiladísimo post sobre Bad Bunny), caí en la cuenta de que Bourdieu es, en realidad, el eslabón perdido entre Veblen y Henderson (de quien hablaremos a continuación).

Bourdieu, que desarrolló su obra 50-70 años después de Veblen, dice que el dinero ya no es suficiente, pues al fin y al cabo vamos a enfocarnos en bienes no materiales, sino que ahora necesitas capital cultural. Aúna por un lado el contexto en que crecemos y nos cultivamos, que determinará en gran medida nuestros gestos, forma de expresarnos, modales, o la cultura a la que nos vemos expuestos desde pequeños y por otro los diferentes ámbitos en que ese contexto es necesario, que no va a ser lo mismo en el ámbito académico o político, o laboral.

El camino que va desde nuestro contexto personal (que Bourdieu llama habitus) hasta los ámbitos donde nos desenvolvemos («campos») lo recorremos con nuestro capital cultural. Ese capital cultural, como cualquier otro capital, no se puede amasar de la noche a la mañana. Es ahí donde reside el quid de todo esto: al poner el foco del estatus en práctica sociales que vienen determinadas por un recurso que no es fácilmente adquisible (si es que es posible adquirir ciertos hábitos que no fueron adquiridos de pequeño) se vuelve a señalar de forma sutil la pertenencia o no a ese grupo.

¿Recuerdan cuando la RAE anunció que quitaba tildes de algunas palabras porque, al fin y al cabo, una mayoría de la población no las estaba poniendo de todas formas? Yo sí. Sólo, guión, o los artículos demostrativos. Hubo un gran revuelo al respecto… en Twitter. Nadie nunca se quejó fuera de la esfera ilustrada que dedicó más de veinte años de su vida a estudiar hasta finalizar estudios superiores (doctorados, ingenierías). Súbitamente todos esos años aprendiendo a domesticar la ortografía dejaban de distinguir a quien escribía bien de quien escribía mal.

He usado el verbo distinguir para viajar hasta el siguiente concepto clave de Bourdieu: la distinción. No se trata de tener en casa un Miró o un Picasso, se trata de poder explicar a Picasso y su influencia sobre las generaciones posteriores (es este relato el que articula el valor de una obra de arte, al fin y al cabo). Aquí enlazamos con Veblen, para poder reaccionar adecuadamente en estos contextos hay primero que poder dedicar horas de ocio conspicuo a estudiar sobre arte. Si tienes que pasar tus días trabajando difícilmente vas a tener tiempo para esto.

Si lo quieren en otras palabras, el Rolex y el traje caro te los compras con dinero, pero saber equiparlos y dejar satisfecho a @dieworkwear ya es más difícil.

Rob Henderson: las creencias de lujo (Siglo XXI)

Avanzamos otro medio siglo y llegamos a la década actual, volvemos a cruzar el atlántico hasta Estados Unidos y hablamos de Rob Henderson, que actualiza a Bourdieu a la era digital y de la postmaterialidad.

Las creencias de lujo son ideas que confieren estatus a la clase alta mientras imponen un coste a la clase baja. Tiene entrada en mi Pedia (Creencias de lujo). Con Henderson vamos a una inmaterialidad total, el bien ya no es un objeto ni un conocimiento artístico refinado, es una postura moral.

Henderson enmarca algunas creencias de lujo actuales en el ecosistema más woke: desde pedir desfinanciar a la policía que hará subir la criminalidad en los barrios más desfavorecidos pero no en los distritos residenciales más exclusivos hasta el poliamor que desemboca en madres solteras abocadas a la pobreza para la que los más privilegiados tienen «red de seguridad» familiar pero cuyo efecto es devastador, de nuevo, para los menos favorecidos.

Del mismo modo, se articula a través de los gustos: cuando fue posible para todos ver Hamilton en televisión sin pagar varios cientos de dólares por asiento, el pijerío neoyorquino empezó a renegar del musical. Si no sirve para distinguirnos del vulgo, hay que mudarse a una nueva creencia de lujo.

Todo esto nos sirve para anticipar sin miedo a equivocarnos que las creencias de lujo de la próxima década no serán necesariamente woke (quién sabe, quizá se vayan al otro extremo) pero seguro que continuarán buscando diferenciar a un grupo de otro y promoviendo actividades para señalar estatus, y cuyas consecuencias sufrirán, de nuevo, los más desfavorecidos.

De la vulgarización de lo material a las nuevas señales de estatus

Este viaje por los símbolos de estatus desde el siglo XIX al XXI ilustra que el desplazamiento del estatus ocurre porque lo material se ha vulgarizado, en el sentido más etimológico, el vulgo, el pueblo, ya tiene acceso a lo material. Hoy cualquiera puede llevar un iPhone en el bolsillo o comprar imitaciones de accesorios de marca (bolsos o calzado) que a simple vista no se diferencian de las versiones exclusivas de firma. Como cualquiera tiene acceso, el lujo físico ya no distingue.

Por eso, la lucha por mostrar ese estatus se ha mudado hacia dos nuevos frentes: lo invisible (el capital cultural de Bourdieu) y lo ideológico (las creencias de lujo de Henderson, donde adoptas causas que requieren una compleja literacidad para no ser cancelado).

En definitiva, es el trepidante y elitista viaje que nos ha llevado desde presumir de mayordomo (Veblen), a presumir de los libros que acumulamos en el salón (Bourdieu), para terminar presumiendo de nuestras opiniones morales en una red social (Henderson).

[Imagenes: Jose Alcántara con Gemini y ChatGPT.]